ChatGPT如何学习人类语言

1、ChatGPT如何学习人类语言

ChatGPT通过深度学习和自注意力机制,模仿人类语言,实现复杂对话和文本生成。

2、ChatGPT如何学习人类语言

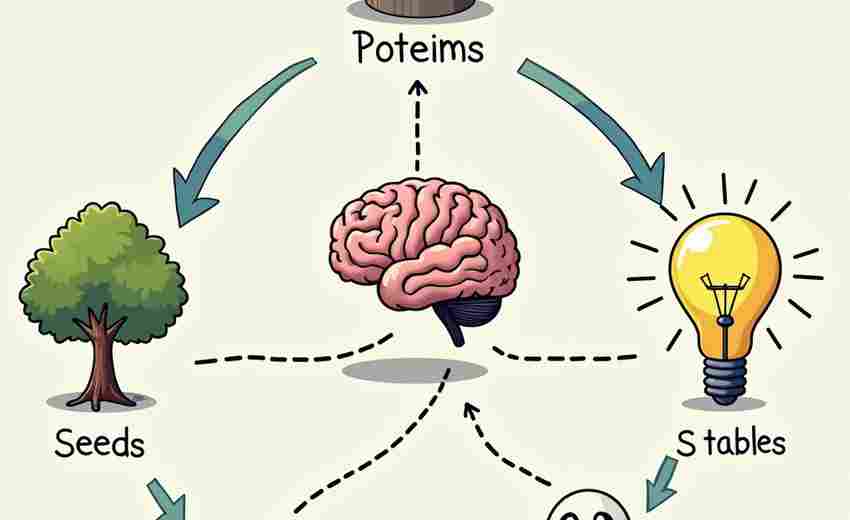

ChatGPT通过Transformer架构和参数优化,模拟人类大脑,理解和生成自然语言。

3、ChatGPT的预训练与微调机制

ChatGPT通过预训练和微调机制,利用海量数据优化模型,提升语言理解和生成能力。

4、ChatGPT如何利用自注意力机制学习

自注意力机制使ChatGPT能捕捉文本中的语言规律,提升对话生成的自然性和准确性。

5、ChatGPT的语言模型训练过程

ChatGPT通过预训练、微调和RLHF等步骤,逐步优化模型输出,确保语言生成的准确性。

6、ChatGPT的核心技术是什么

ChatGPT的核心在于深度学习、自注意力机制和Transformer模型,提升语言处理能力。

7、ChatGPT中的Transformer架构如何工作

Transformer架构通过Encoder-Decoder结构,处理任意长度输入,实现高效并行计算。

8、生成模型在ChatGPT中的应用

生成模型在ChatGPT中用于文本生成,通过神经网络实现自然流畅的语言输出。

9、ChatGPT如何模拟人类学习

ChatGPT通过深度学习和神经网络,模拟人类的学习过程,实现语言的自然生成。

10、ChatGPT的学习过程与人类学习有哪些相似之处

ChatGPT通过自监督学习和数据训练,模拟人类的学习方式,提升语言理解和生成能力。

11、ChatGPT如何优化参数和记忆语言模式

通过参数优化和语言模式记忆,ChatGPT不断调整模型,提高语言生成的准确性。

12、ChatGPT未来发展方向

ChatGPT将在智能客服、医疗健康等领域扩展应用,提升个性化服务和效率。

13、ChatGPT如何实现持续学习与进化

通过预训练和微调,结合用户反馈,ChatGPT不断优化性能,实现自我进化。

14、ChatGPT如何扩展多语言支持

ChatGPT通过多语言功能更新,逐步实现多语言支持,提升国际化交流能力。